By accepting you will be accessing a service provided by a third-party external to https://www.incgmedia.com/

NVIDIA Maxine SDK 視訊會議新革命,運用 AI 技術將最完美的姿態呈現於與會者面前

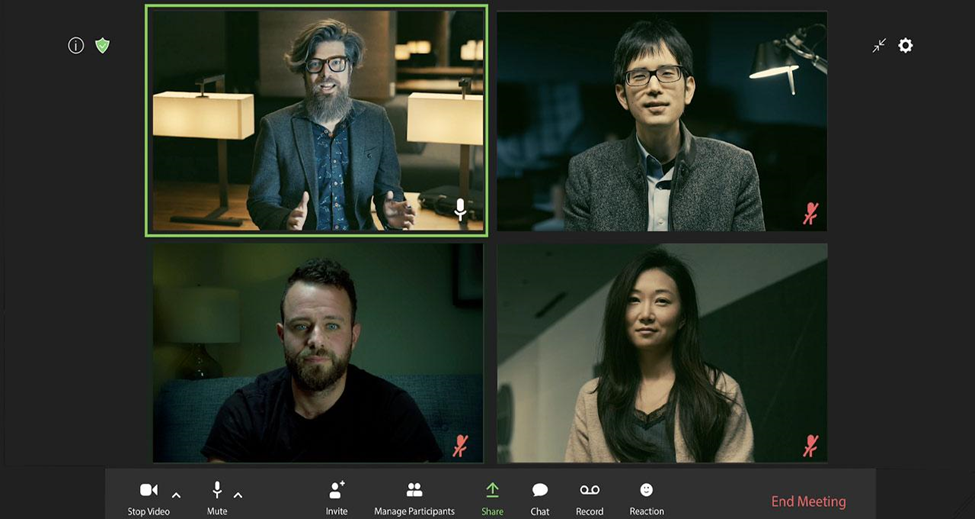

在疫情蔓延的現在,人們工作往往會使用到視訊會議的功能。本次 NVIDIA 推出嶄新的視訊會議新技術 NVIDIA Maxine SDK,將讓常見的視訊窘境成為過去式,讓我們來探索一下這個新技術吧。

NVIDIA Maxine SDK將改變人們對視訊會議的想像

在 NVIDIA (輝達) 研究人員開發的人工智慧 ( AI ) 協助下,從起床到打開筆電和網路攝影機,讓我們能在每次進行視訊通話時,呈現最完美的一面。

NVIDIA 針對視訊會議推出的 NVIDIA Maxine SDK,背後運用眾多深度學習模型,其中包含 Vid2Vid Cameo,該模型使用生成對抗網路 ( GAN ),只要使用單一人像平面照片,就能在視訊通話中合成出說話者栩栩如生的立體頭像。

參與者只需要在加入視訊通話前先上傳一張參考圖片,不論是自己的真實照片或卡通圖片,皆能使用這項功能。開會時,AI 模型會捕捉每個人的即時動作,接著將這些動作套用在先前上傳的靜態圖片上。

這意味著只要與會者先上傳好穿著正式服裝的照片,就算剛起床且頂著一頭亂髮、身上還穿著睡衣,直接進行會議也完全沒問題,因為 AI 會將與會者的臉部動作套用在靜態的參考照片上,讓我們能在會議平台中展現正式的穿著打扮。要是與會者將身體轉向左邊,這項技術可以調整視角,讓畫面看起來像是正對著網路攝影機。

除了讓與會者看起來裝扮得宜之外,這項 AI 技術還能將視訊會議所需的頻寬減少十倍,以避免出現畫面不穩和延遲的情況。該技術很快就會在 NVIDIA Video Codec SDK 中,作為 AI Face Codec 供大家使用。

這項專案的共同作者,也是 NVIDIA 的研究人員劉洺堉( Ming-Yu Liu )表示:「許多人使用的網路頻寬有限,但還是想要與親友們流暢地在網路上聊天,而這項技術除了能協助他們之外,還能協助動畫師、照片編輯和遊戲開發者完成手上的工作。」

NVIDIA 本週將於著名的 Conference on Computer Vision and Pattern Recognition (CVPR) 大會上發表 Vid2Vid Cameo,這是 NVIDIA 在這場線上大會中發表的 28 篇論文之一。Vid2Vid Cameo也可以在 AI Playground 上找到,任何人都可以在那裡親身體驗我們的研究展示。

AI 全面提升視訊效果

透過以下影片更加暸解Vid2Vid 及Vid2Vid Cameo:

只需要兩個元素,便能讓視訊會議暢行無阻

全新 NVIDIA Canvas 應用程式測試版

NVIDIA 今天推出 NVIDIA Canvas 應用程式測試版,創作者使用素材而非顏色進行作畫,透過 RTX 加速的人工智慧 ( AI ) 將筆觸變成逼真的影像。藝術家在這個應用程式裡還能套用風格濾鏡,將創作中的影像變成特定畫家的風格。RTX 用戶可以下載和試用 Canvas 應用程式測試版,同時歡迎在 NVIDIA 論壇上與我們分享心得。

本文經 NVIDIA 授權發布,內容僅有做字詞修改,保留作者所述內容,但不代表映CG 立場。如需轉載請聯絡原作者。